beautifulsoup 爬虫 BeautifulSoup爬虫基础概念、安装方法及使用实践全解析

目录 基础概念 安装方法 使用方法常见实践最佳实践小结参考资料1. 基础概念

是一个用于解析 HTML 和 XML 文档的 库,由 开发。它提供了简单易用的 API,允许开发者通过标签名、类名、ID 等方式快速定位和提取文档中的元素。其核心功能是将 HTML 或 XML 文档解析成树形结构,每个节点都是一个对象,开发者可以通过这些对象进行遍历、搜索和修改操作。

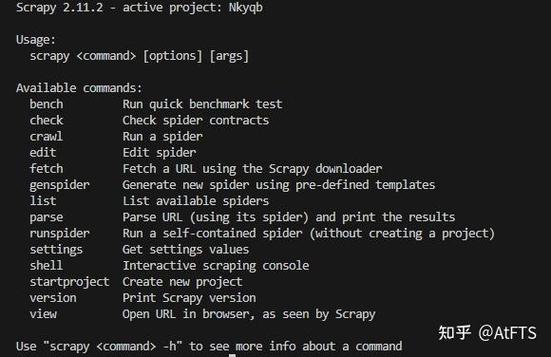

2. 安装方法使用 pip 安装

pip 是 的包管理工具,使用它可以方便地安装 。打开命令行终端,输入以下命令:

pip install beautifulsoup4如果你使用的是 3,pip 通常会自动关联到 3 的环境。如果你同时安装了 2 和 3,可能需要使用 pip3 命令:

pip3 install beautifulsoup4使用 conda 安装

如果你使用的是 或 环境,可以使用 conda 命令进行安装:

conda install beautifulsoup4安装解析器

本身并不具备解析 HTML 或 XML 文档的能力,它需要借助解析器来完成这个任务。常见的解析器有 html.、lxml 和 。建议安装 lxml 解析器,因为它速度快且功能强大。使用 pip 安装 lxml:

pip install lxml3. 使用方法引入库和解析文档

from bs4 import BeautifulSoup

# 示例 HTML 文档

html_doc = """

示例页面

欢迎来到示例页面

这是一个示例段落。

"""

# 创建 BeautifulSoup 对象

soup = BeautifulSoup(html_doc, 'lxml')

# 打印文档的格式化版本

print(soup.prettify())查找元素

# 通过标签名查找元素

title = soup.title

print(title) # 示例页面

# 获取元素的文本内容

title_text = title.get_text()

print(title_text) # 示例页面

# 通过类名查找元素

paragraph = soup.find('p', class_='content')

print(paragraph) # 这是一个示例段落。

4. 常见实践爬取网页内容

import requests

from bs4 import BeautifulSoup

# 发送 HTTP 请求获取网页内容

url = 'https://example.com'

response = requests.get(url)

html_content = response.text

# 解析网页内容

soup = BeautifulSoup(html_content, 'lxml')

# 查找所有链接

links = soup.find_all('a')

for link in links:

href = link.get('href')

print(href)提取表格数据

import requests

from bs4 import BeautifulSoup

url = 'https://example.com/table'

response = requests.get(url)

html_content = response.text

soup = BeautifulSoup(html_content, 'lxml')

# 查找表格

table = soup.find('table')

# 遍历表格的每一行

rows = table.find_all('tr')

for row in rows:

cells = row.find_all('td')

for cell in cells:

print(cell.get_text())5. 最佳实践错误处理

在爬取网页时,可能会遇到网络错误或网页返回状态码异常的情况。因此,需要进行错误处理:

import requests

from bs4 import BeautifulSoup

url = 'https://example.com'

try:

response = requests.get(url)

response.raise_for_status() # 检查响应状态码

html_content = response.text

soup = BeautifulSoup(html_content, 'lxml')

# 处理网页内容

except requests.RequestException as e:

print(f"请求出错: {e}")遵守网站规则

在进行网页爬取时,需要遵守网站的 .txt 文件规则,避免过度请求对网站造成负担。可以使用 库来检查是否可以访问某个网页:

import urllib.robotparser

rp = urllib.robotparser.RobotFileParser()

rp.set_url('https://example.com/robots.txt')

rp.read()

if rp.can_fetch('*', 'https://example.com'):

# 可以访问该网页

pass

else:

print("不允许访问该网页")小结

本文详细介绍了 的安装方法、基础概念、使用方式、常见实践以及最佳实践。通过学习,读者应该能够掌握如何安装和使用 来解析 HTML 和 XML 文档,提取所需的数据。同时,也了解了一些在实际应用中需要注意的事项,如错误处理和遵守网站规则。

参考资料